FM音源からナムコ独自のPCM音源へ。テクノロジーの進化はナムコのアーケード基板のサウンドシステムを急速に発展。その様子を第8回バンダイナムコ知新の第2章の前編、中編でお伺いしました。今回は、同時期に進化を遂げていった家庭用ゲーム機のサウンド制作環境についてお伺いしていきます。

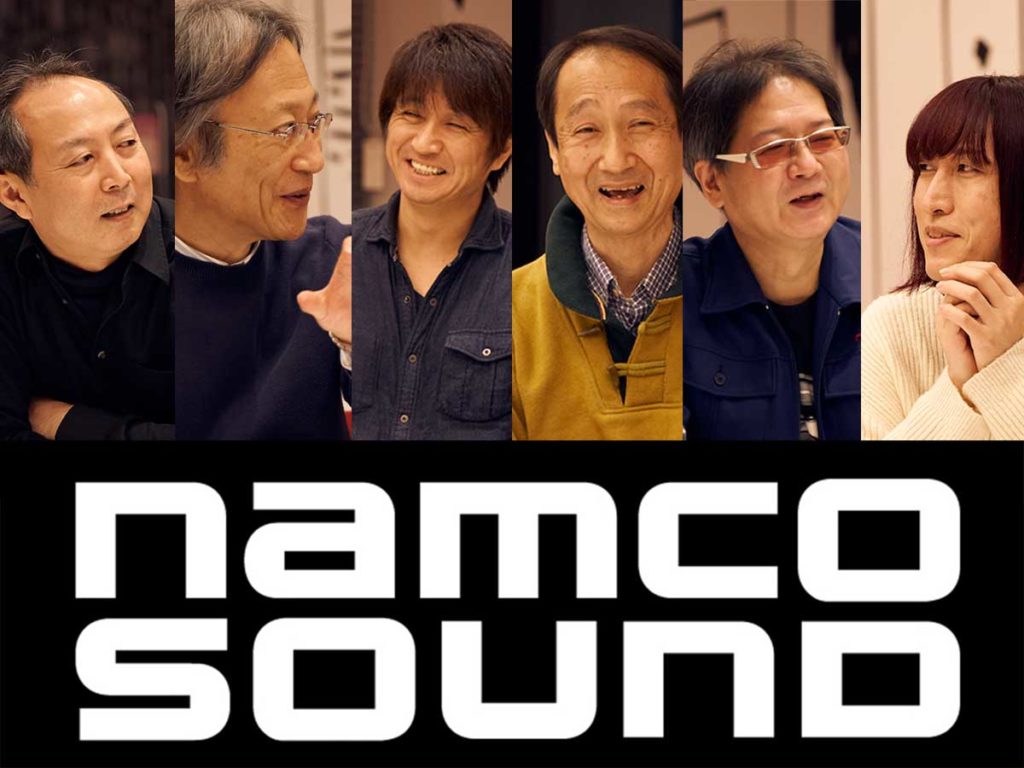

小川 徹

細江 慎治

1985年、ナムコ(当時)のテストプレイにアルバイトとして参加、同年グラフィックの手伝いを経て、秘密裏に『ドラゴンスピリット』にサウンドを載せて1987年正社員登用。花博(1990年:国際花と緑の博覧会)に出展した『ギャラクシアン3』、『リッジレーサー』、『スピードレーサー』等を担当。1996年退職後も「リッジレーサー」、「鉄拳」シリーズ等や他に参加。現在は作家としても活動中。

川田 宏行

1984年、ナムコ(当時)に入社。 開発企画課での『スターラスター』、『ワルキューレの冒険』開発を経てサウンド部門へ。『妖怪道中記』、『ワルキューレの伝説』、『ソルバルウ』、『ナムコ・ワンダーエッグ』、『パックマンCE 2』、『プラ・ソニック・ラブ!』、『大乱闘スマッシュブラザーズ for Nintendo 3DS / Wii U』など多くのサウンドを担当。現在は、作編曲家としてオリジナルCD制作の他、『大乱闘スマッシュブラザーズ SPECIAL』、『アリス・ギア・アイギス』など、幅広く活動中。

中西 哲一

1996年、ナムコ(当時)に入社。代表作は「リッジレーサー」シリーズ、「エースコンバット」シリーズ、『サマーレッスン』など。クリエイターとプログラマの橋渡しを得意とし、サウンドディレクター/テクニカルサウンドデザイナーとして多くのタイトル開発に携わる。現在はバンダイナムコスタジオにて所属グループマネジメントやオーディオ技術開発リーダーを担当。

黒畑 喜弘

小さい頃からのナムコ好きが高じ、1998年にナムコ(当時)に入社。『リッジレーサー7』のサウンド実装を機に社内サウンドフレームワーク「NUSound」の開発に携わり、「KORG Gadget」用シンセサイザープラグイン「Kamata」では過去の社内資料を基にC30音源を再構築。代表作は『太鼓の達人』の「スーハー2000」(ボーカル)。

大久保 博

1994年、ナムコ(当時)に入社。代表作は「リッジレーサー」シリーズ、「エースコンバット」シリーズ、「鉄拳」シリーズなど。バンダイナムコスタジオサウンドチームを経て、現在はバンダイナムコ研究所に所属し、XR、AI技術のビジネスプロデュースや新技術「ELMIRAIVE™AX(旧称:BanaDIVE™AX)」の開発等に携わる。

各機種でイチから作っていた家庭用タイトルのサウンドドライバ

――前回の流れから続いて、家庭用の方のお話も伺いたいのですが、第1章ではナムコ(当時)がファミリーコンピュータに参入されてから、サウンドクリエイターの皆さまはアーケード、家庭用と部門が分かれるまでどちらも担当されていたことがあると伺っておりますが、当時はどんどんハードウェアが進化していくアーケードと、ハードウェアが基本固定の家庭用ゲーム機と、お仕事としてどう捉えていらっしゃったのでしょうか?

大久保:第1章で小沢さん(※1)たちがお話しされていたのは、アーケードタイトルを家庭用に移植するのは、取り外していく作業(仕様を削ったり、映像の質を家庭用のハードに合わせたり)だということで、家庭用ハードに移植することを「落とす」という言葉で表現をされていましたが、実際家庭用の作業は、そういったモノが多かったのですか?

※1 小沢純子:サウンドクリエイター。代表作は『ギャプラス』『ドルアーガの塔』『トイポップ』『スカイキッド』など、多くのサウンドを担当。現在は、フリーの作曲・演奏家として活動する。

細江:移植タイトルが多かったですよね。

川田:はい。

細江:古いころのオリジナルのIP(※2)タイトルは社内で開発していたけれども、それ以外ってわりと外注が多くなっていきましたよね。

※2 IP:Intellectual Property=キャラクターなどの知的財産

小川:その時ってサウンドドライバとかはナムコ(当時)から出していたの? それとも、それぞれドライバを用意していたの?

黒畑:入社してから知った話ですが、サウンドだけ内製というのも多かったそうで、例えば川元さん(※3)はPCエンジンなどで多くのタイトルのサウンドを担当されていますね。

※3 川元義徳:サウンドクリエイター。『スプラッターハウス』や『バーニングフォース』などのサウンドを手がけ、「太鼓の達人」シリーズにも携わる。

大久保:中潟さんは第1章でも話されていたように、『源平討魔伝』のファミリーコンピュータ版のサウンドを担当されて、とても苦労されたとお伺いしました。

――そうなると、皆さんが家庭用ゲーム機のサウンドに携われたのはPlayStationあたりからとなるのでしょうか?

中西:私と黒畑さんはPlayStationぐらいからですね。

大久保:PlayStationの立ち上げは『リッジレーサー』(1994年12月3日)なので、あれは石井悦夫さん(※4)が移植をやっていましたよね。

※4 石井悦夫:サウンドクリエイター。『未来忍者』『マーベルランド』『プロップサイクル』などに携わる。

――ファミリーコンピュータやスーパーファミコン、メガドライブやPCエンジンなどは? あのころは各社より提供されていたドライバで書かれていたんですか?

川田:私はファミリーコンピュータ、PCエンジンから一通りやりました。

大久保:小沢さんがドライバを書いたやつがあって。僕が入社した時、研修で触ったのがメガドライブだったんですけれど、いわゆるナムコフォーマットでしたよ。

FM音源パートと、PSG(DCSG)パートに分かれていて。それをSDC(※5)に送って鳴らすという研修をするのですけれど。FMパートの音色は、YAMAHA DX21内で作ったものをシステムエクスクルーシブ(※6)でPCに書き出して、それをSDCに送って鳴らすという作業をやっていました。だから、ナムコ(当時)のドライバでしたね。

※5 SDC:Spot Data Carrierの略で一時的にデータを載せるもの。PCからシリアル通信でシステムボードに送る仕組み。詳細は後述。

※6 システムエクスクルーシブ:MIDI規格において特定の音色パラメータや自動演奏のためのプログラムデータを伝送・制御するための特殊なデータ。

――スーパーファミコンは最終的には自社開発のドライバを作られたんですか?

大久保:僕の入社後の話ですけど、現在「アイドルマスター」シリーズ等のサウンドプロデュースをしている中川さん(※7)が『スーパーファミリーゲレンデ』(1998年2月1日)を開発する際に「初めて自分でサウンドドライバを作る」ということで、小沢さんに教わりながら作っていて、開発途中でバグが起きてすっごい音がしていたのが僕の楽しい思い出の一つです(一同笑)。

※7 中川浩二:アーケード『アイドルマスター』や『テクノドライブ』、家庭用ではPlayStaton『R4 -RIDGE RACER TYPE 4-』、『エースコンバット3 エレクトロスフィア』などを手掛けたサウンドクリエイター。

川田:すっごいって?

大久保:なんか、こんな音出るんだというような未来の音がしていました。開発中のバグだったみたいです。でもそのころは、「技術を突き詰める」という空気が社内全体にあって、小沢さんや細江さん、川田さんもそうだと思うのですが、すごくプログラムチックで技術的なところに踏み込んでいましたよね。みんな必死でした。

中西:自分たちが音で表現したいことと、そのサウンドデータの作りやすさを考えると、まずはドライバを作ることになるのではないですかね。

大久保:単に曲や音を作ればいいだけの世界ではないところにもっと入っていくというのかな、なんだろう。上物としてハードがあって、ドライバがあって、音を作ればいいやという発想以上の考え方ができているのは、そこの文化みたいなものがあったのだろうなという。

黒畑:全部自分たちの手でやろうとしているというのがすごいですよね。そういう技術が継承されているとか、そこに労力を割くというのはなかなかなかったのではないかなと。

「こういうものを作ったら便利じゃないか?」で生まれたSDC

――大久保さんからお話が出た、SDCってどんなものなんでしょうか?

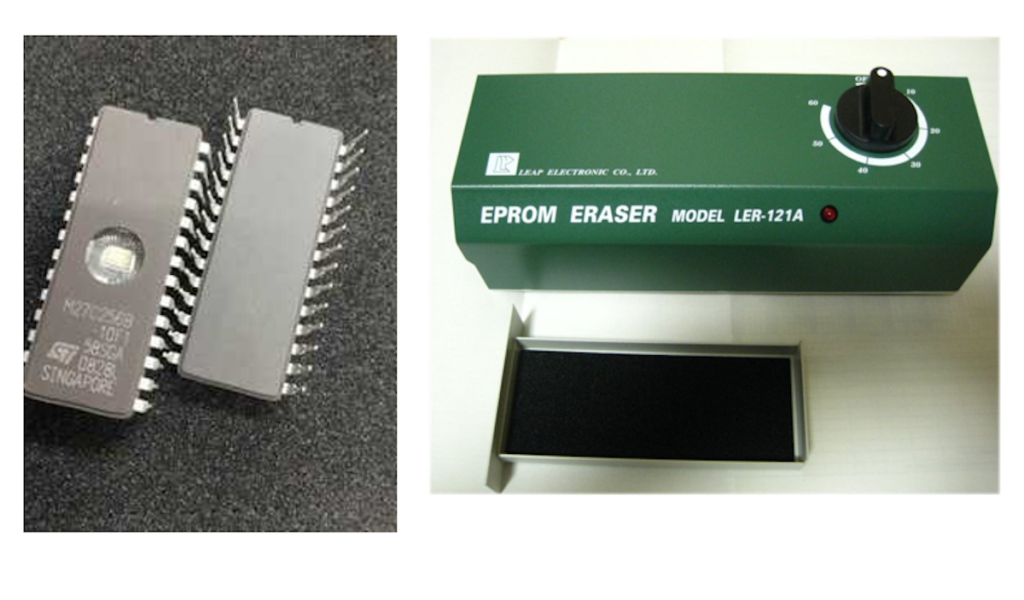

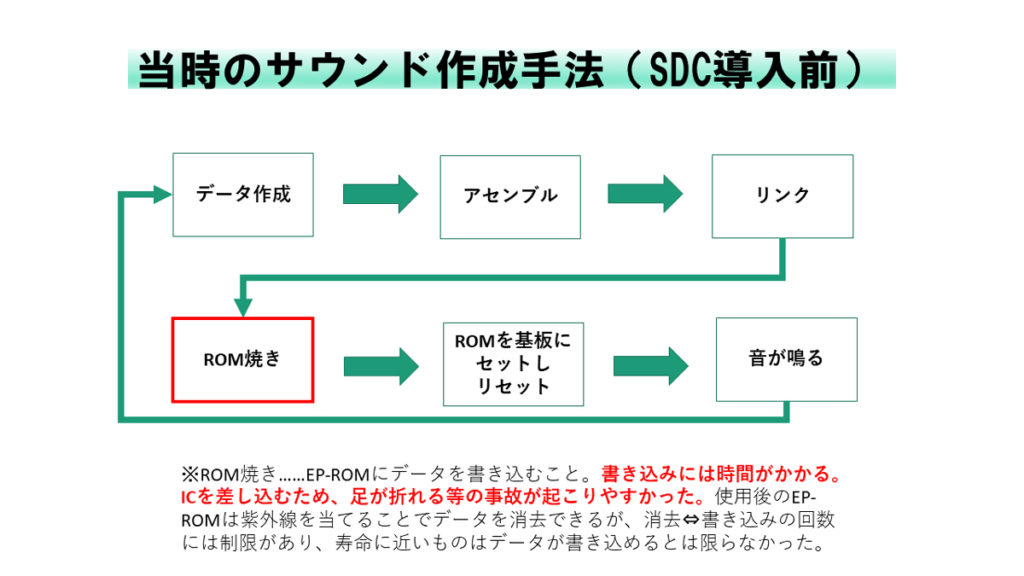

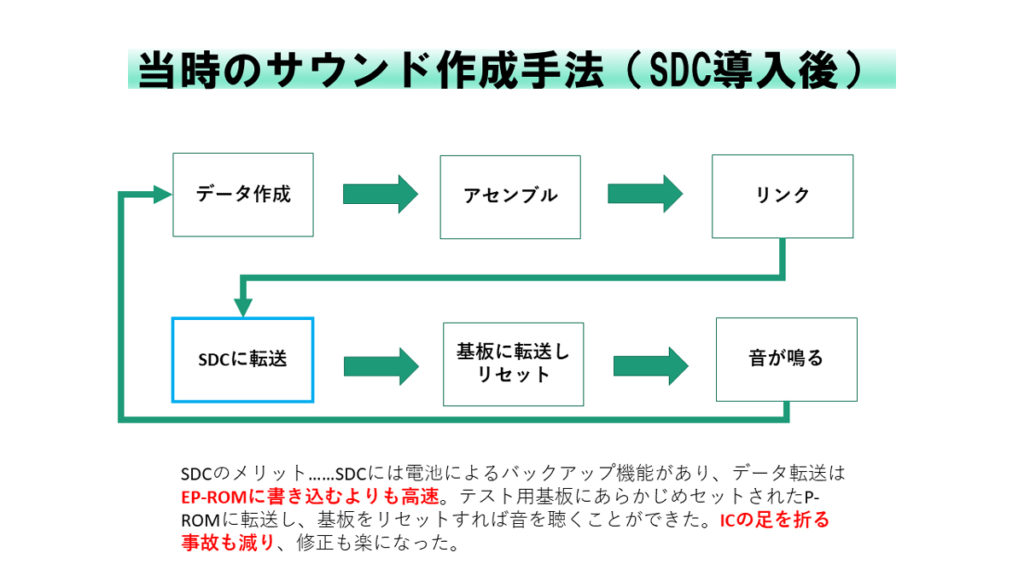

小川:SDCって、昔はプログラムとかをEP-ROMに焼いていたじゃないですか。あれをなくす機械なんですよ。データを作ったPCからシリアル通信でシステムボードなどに送るという仕組みなんです。そこに転送するので、いちいちROMを焼かなくてもいい環境にしたんです。

最初はEP-ROMみたいな大きなものしかなかったんですけれども、そのうちP-ROMみたいな高速なものまで、いくつか作りました。とにかくROM焼きですごく苦労している人たちがいたので。しかもEP-ROMって100回ぐらいしか書けないんですよね。それよりも早く書き込めなくなるものがいっぱいあったんです。

川田:ありましたありました。

黒畑:見た目では分からないので、焼いてみて選別して使っていましたよね。消すときはROMイレーサーって「チンッ」って鳴るやつで。

川田:電子レンジみたいな音がして。

小川:だからちょっといじって試してみるというのがやりやすくなったんですよね。

――ROMを焼いてから試すことをしなくてよくなったのは大きな変化ですね。

小川:自分で言うのもなんですが、大きいです。

細江:SDCができた時「神だ!」と思ったので。

川田:それまではROMをいちいち焼いていたので……。助かりました。

細江:時期としてはたしか1986年とか……その年の途中でROM焼きから解放されたんですよ。

それでも、アセンブルしてリンクしてSDCに送って基板をリセットして起動、それでも実際に音が出るまで分単位で待たされるので、SDCを使っても大変は大変なんですよね。

大久保:慶野さんが言ってましたもんね。「ROMを焼かないと音が出ないから」と頭の中で想像したものをデータ作って鳴らしてみて確認して……。ただ、ジョイスティックやボタンで作った音がすぐ鳴る治具を大野木宜幸さん(※8)が作ってくださったという話を伺いました。ただ、波形はあるものから選ぶしかできなくて、データのセーブができなかった。

※8 大野木宜幸:『ラリーX』『ニューラリーX』『マッピー』『リブルラブル』などの作曲も担当したプログラマーでありサウンドクリエイター。ナムコ(当時)側の担当としてサウンド収録に協力し、ゲームサウンドの音源化やアルバムのプロデュースも手掛けた。

小川:SDCは電池を積んでいましたので。

大久保:SDCはROMを使うハード関係をやらなければならない時は僕もずっと使っていたので。

小川:ずっと使われていたんだね。素晴らしい。もしかしたらそれが一番貢献したのかな?(笑)

細江:あれはもう全社的に貢献しているんじゃないかな。

小川:SDCって私が名付けたんですけれど、「Spot Data Carrier=一時的にデータを載せるもの」みたいな。

大久保:それは聞いたことがなかったですね。みんなSDCって呼んでいたから。

――SDCはどこかの部署からの要望で作られたんですか? それとも小川さんが自主的に?

小川:そうですね。社内で苦労している人を見て、「これはこうすれば改善できるのでは?」と作ってみた気がしますね。

中西:昔はなんでも勝手に作ってましたよね。本当に。

小川:そうだね。「同じものを作ってるこいつ」なんて無駄なこともやったりして。

――それが結果、開発の皆さんに多大な貢献となったSDCにつながったというのはとても興味深い話です。

大久保:そのころって、最初は開発現場と音関連のプログラムをやっていた専門の部署は特になくて、ゲーム開発全体の中で作られていたような時代もあったと思うんですけれど、「サウンド専門チーム」みたいなものって、技術側にあったりしたんですか? 担当者レベルで小川さんみたいな方は……。でも小川さんはサウンドだけが担当だったわけではないですよね?

小川:私はハードウェア開発全般でして、それこそシステム86だとか、システムボードの設計がメインでした。

――貴重なお話ですね。ありがとうございます。

CDメディアへの対応に生きたビデオゲームアルバムの収録

――こちらから脱線してすみません。PlayStation以降のサウンド開発はどうなっていったのでしょうか?

大久保:PlayStationの時、最初はハードウェアメーカーさんのツールを使っていたよね。

中西:やはり出来立てのハードだと、まずは提供されたものでやってみて、ハードを触っているうちにそこからもっと「こんなことはできないの?」といった要望が出てくるわけですね。家庭用の場合、ハードは先に(仕様が)固まってしまいますから、できないことをできるようにするためにはソフトウェアと作り方だけなので、そこに手を入れるしかないんですよ。

大久保:そうだね。ちょうどタイミング的にいわゆるCD音源を鳴らさなきゃ、となったのはPCエンジンのCD-ROM2のあとはPlayStationぐらいの時期ですかね。

<ライター解説>

ナムコ(当時)はPCエンジン向けにソフトをリリースしたが、CD-ROM²には参入していない。この時期は家庭用ソフト開発部署ではCD-ROMの基礎研究が行われており、その成果がPlayStation

の本体発売同時リリースとなった『リッジレーサー』(1994年12月3日)に結実している。

川田:うんうん。でしょうね。

中西:ストリーミングで鳴らすのも、CD-DA(※9)でCD音源をそのままを流すだけでなく、オーディオ圧縮技術によってたくさんのサウンドデータを入れられるようになっていたので、音の表現が大きく進化していきましたね。

※9 CD-DA:Compact Disc Digital Audioの略。コンパクトディスク(CD)にデジタル音声データを記録する規格。リニアPCM(44.1kHz/16bitステレオ)が主な仕様。

大久保:そこがちょうど切れ目で、それまではデータを打ち込んで内蔵のシーケンサー、シンセサイザーとして鳴らしていたものを、今度は「録音して鳴らす」という形になっていって。

そこから家庭用専用で出てくるものに関しては、打ち込みを基板でやらなくてもいい時代になっていきました。音としては一般的に販売されているCDなどと同じような作り方になるので、ガラッと変わりましたよね。

川田:それに関連する話としては、音源チップで作っていた時代も幸いゲームミュージックに人気が出てきたこともあって、レコード化やCD化する機会というのがずいぶん増えていって。「この期間はサウンド制作をお休みしてレコーディング」みたいな形で郊外のスタジオで合宿などをやっていましたね。

そこでレコード会社さんのレコーディングスタジオでプロのアレンジャーさんと一緒にお仕事して、将来に向けて学べたものがけっこう多かったと思います。

中西:そのころにゲーム業界と音楽業界が繋がりはじめて、音楽業界のワークフローとか設備を使う機会ができはじめたところですね。

小川:当時からCDとしても聞ける素晴らしい音楽が鳴っていたからではないですかね。「ゲームミュージック」という。レベルの高い音を、音源チップを使ってサウンドを制作していたから、アルバム化されることになったのでしょうね。

川田:そんな形でノウハウをある程度蓄積してきていたので、CDを音源として使う時代になってもスタジオでのレコーディング作業など戸惑うことなく行うことができたんです。

大久保:そうですよね。僕が1994年入社で、その年の12月にPlayStationが発売されたんですよ。入社していろんなフロアを見せてもらったりしたなかで、ちょうど『リッジレーサー』が移植されて動いているところを見せてもらって「ああ、『リッジレーサー』が動いている!」と感動したのを覚えています。

CD-ROMが家庭用タイトルの記録メディアとして標準になるまでは、ナムコ(当時)だけでなく業務用からの移植タイトルが主軸という考えが当時はあったと思うのですが、シンセサイザー的内蔵音源ですべてをまかなっていたところからからストリーミングと内蔵音源の併用へという時代の変化に対して、サウンドチーム的には、思うところはありました? それまではドライバで内蔵音源を細かく制御できていたんですけれどCD-DAからのストリーミングに対して、それまでより細かい制御が難しくなりましたよね?

細江:自分はちょうどそのころ花博の担当で『ギャラクシアン3』(※10)をやらせていただいていて。

※10 ギャラクシアン3:1990年に大阪で開かれた「国際花と緑の博覧会」にハイパーエンターテインメント構想に基づく大型遊園施設として『ドルアーガの塔』とともに出展された28人同時プレー可能なシューティングゲーム。その後1992年に二子玉川に開園した「ナムコ・ワンダーエッグ」に移設。

大久保:『ギャラクシアン3』は、あらかじめ楽曲は収録された状態(今でいうストリーミング)で制作されていたんですよね?

細江:はい、普通のオーディオとして作っていたので。

業務用と家庭用の注力バランスの変化でサウンドシステムの効率化が進む

小川:PlayStation時代の業務用のシステムボードで言えば「システム11」がまず初めに思い浮かびますね。「サウンド部分はどうする?」と相談した時、「今まで業務用で使っていたものを載せてほしい」という要望をもらってC352(※11)などを載せたんです。

※11 C352:PCM32chに対応したナムコカスタム音源。システム基板としてはシステム22などに使われ『リッジレーサー』(1993年)、『リッジレーサー2』(1994年)、『エースドライバー』(1994年)、『サイバーコマンド』(1995年)、『レイヴレーサー』(1995年)などに採用された。

だから、業務用担当からすると今までと同じで使いやすいシステム基板だったと思いますが、それを移植する家庭用担当からすると、まったく違うものなのですごく大変だったと思います。そのあとになると家庭用の(サウンド用)チップをそのまま使う時代(システム10世代~)に移り変わっていきますけどね。

大久保:「システム11」は『Jリーグサッカー プライムゴールEX』を作りましたよね。あれはPlayStation版が先にリリース(1995年9月29日)されて、発売後に「システム11」に移植します(1996年)と言われて「(サウンドデータ)全部これ打ち込み直さなくてはいけないの?」って(一同笑)。

小川:やっぱり。

大久保:それでクワトロ(※12)を覚えました。僕が最初に触ったのはMac版のNubus(※13)のやつで、メニューの「変換」から「システム11」を選んでコンバートするというものでした。

※12 クワトロ:小川さんが開発に関わったC352(PCM音源)に対応したドライバ。

※13 Nubus:パラレル転送を行う32bitバス。

黒畑:家庭用から業務用へという逆のパターンもあったんですね。

大久保:そうそう。だから先に、家庭用のデータができていて、MIDIデータを見ながら打ち込むという(笑)。

小川:そういうこともあったんだなあ。

タイトルごとの制作からインタラクティブに特化したサウンド環境の統一へ

大久保:でも、社内のその流れから問題意識があったのも事実なので、徐々に「社内製ドライバをなんとかしなくては」という話になっていくと思うんだけど、そこの立ち上げはなかにい(中西さんの愛称)入っていたよね? 中村さん(※14)たちが最初言っていた時代があったなと思って。

※14 中村和宏:『エアーコンバット22』や『タイムクライシス』など、ナムコ在職中はおもにアーケードゲームのサウンド制作を手掛けたサウンドクリエイター。退社後も『テイルズ オブ イノセンス』やフリーランスとして『タイムクライシス5』のサウンドに関わる作・編曲家として活動。

中西:中村さんにいろいろ教えてもらったので、話は出ていたかもしれないですね。業務用と家庭用は部署も分かれていましたが、移植は大変だよねという話をしつつ「これからの(ドライバを含む)サウンド制作はどうしたらいいのかな?」というディスカッションは仲間内でよくしていたと思います。

――NUSoundの最初の立ち上げのきっかけを教えてください。

中西:私は大久保さんのあと、1996年1月入社だったのですが、当時PlayStationが発売されてゲームがいくつか出はじめていました。最初はやはりプラットフォームメーカーの提供ソリューションとAPI(※15)でサウンド制作していました。そしてだんだん並行して複数のタイトルを掛けもちで作るようになってきました。

※15 API:Application Programming Interfaceの略。異なるソフトウェアやアプリケーション間で機能を共有するための仕組み。

それぞれのタイトルごとのプログラマーさんに毎回同じような表現や工夫をお願いして、そのプログラマーさんなりに実装してもらうのが「億劫だな」と感じていたんですね。そこから、どのゲームでも使えるように同じデータを読み込ませて、その中のデータを変えるだけで動くような仕組みを作ったほうがいいだろう、ということからまずはじめました。それはまだ「NUSound」という名前ではなく、「GV-79」というコードネームでした。

黒畑:それはいつごろですか?

中西:『エースコンバット3 エレクトロスフィア』(2000年12月)がそうだったかな?

大久保:『リッジレーサーレボリューション』(1995年)のあと『レイジレーサー』(1996年12月)のころか。「エンジン音をちゃんと鳴らしたいね」という話になった時に、プログラマーさん側からもらったパラメータを使ってサウンドデザインをするということが、元々付いているドライバではスムーズにできなくて。

プログラマーさんに「サウンドのこれを使ってピッチをここで変えて、音量を変えて、というのをグラフで僕が入力するから、それを鳴らせるようにするように作ってもらえますか?」ってお願いしないと制御ができなかったんです。サウンド側からだと自由なことが生み出せないという時期で「(サウンド用の)ツールを作ってくれ!」と言って1タイトルに1個ずつ特別なツールをプログラマーさんに作ってもらっていました。

業務用リッジシリーズの担当者である石井さんにエンジン音の話を聞きに行ったら、Excelかなにかのグラフのデータを見せてくれて、多分あれは『レイブレーサー』(1995年)の時だと思うのだけど。「エンジン音はこれで作っています」という話を聞いたりもしていました。

だから、サウンド側でコントロールできない部分をなんとかしたいなと。

――PlayStationの時代ぐらいからはハードウェアも高度化してきましたよね。できることが増えた半面、複雑化してツールを用意しても、クリエイター側からするとゲームに合わせて何かやろうとすると難しい、ということもあったのでしょうか?

大久保:ナムコ(当時)のサウンドってこれまでの記事の通り歴史があって、大先輩方が作ってきた流れで言うとインタラクションという部分の設計がすごくよくできているなと僕は感じていたんですね。

黒畑:その辺は各タイトルのサウンド担当プログラマーのやる気次第という(一同笑)。

中西:やる気とクリエイターの熱意を伝えて協力してもらうという感じでした。

黒畑:「いろんなタイトルでそういうことをやりたいよね」という理想もあって。

だからサウンドライブラリというのは効率重視の「マルチプラットフォーム」よりもまず「マルチタイトル」。いろんなタイトルで同じやり方でもっとサウンドのおもしろい演出をできるようにしようというところから来ているということですよね?

中西:そうです。今調べ直したら、PlayStation時代で最初はいったん独自ドライバはなしでやっていましたね。全部プロジェクトごとにプログラマーに仕様を発注していて、ツールを作ってもらって……というのをバラバラにやっていました。

そのころはそれで機能もクオリティもそれなりにやれていたんですけれども、だんだん制作ボリュームが増えてきて、同じような仕様をばらばらに発注しているという状況は変えていこうという要求が自分を含めクリエイターたちから出てきました。

本格的に共通の仕組みで動くようにしようという流れはPlayStation2のころからですね。2000年にPlayStation2用の共通のドライバを作ったのが最初ですね。

大久保:『R:RACING EVOLUTION』(2003年11月23日)(※16)を作った時はそれを使いましたね。

※16 『R:RACING EVOLUTION』:PlayStation2以外にもニンテンドーゲームキューブ、Xbox用と3タイトル同時に発売されたレーシングゲーム。

まずはPlayStation2の環境から共通化がスタート

中西:マルチプラットフォーム向けになる前にまずはPlayStation2向けにスタートしました。当時、私が複数タイトルを掛け持ちでやりはじめようとしていた時期で、『エースコンバット04 シャッタードスカイ』(2001年9月13日)を作った時に、このタイトル以外でも使えるようにドライバを設計して、ほかのタイトルでも使おうとしたのが原型になりますね。

このころExcel+VBAを使ってデータを作ると非常に自由度が高く作りやすいなということで、Excelに必要なパラメータをずらっと並べて編集したものをゲームサウンドデータに変換する仕組みを用意しました。そのデータをプログラマーが読み込んで使うだけで楽にやりたいことを実現しやすいAPIを提供しました。誰かひとりががんばって苦労すれば、ほかの人はそれを利用するだけ、というメリットを実感できた最初でした。

それが『エースコンバット04 シャッタードスカイ』、『ソウルキャリバーII』(2003年3月27日)。それにこれは家庭用ではないですが、『O.R.B.S.』(※17)の『スターブレード オペレーションブループラネット』(2001年9月)でも使われていました。

※17 O.R.B.S.:Over Rearity Boothter Systemの略。2001年9月に行われた第39回AM(アミューズメントマシン)ショーに出展するために作られた半球ドームスクリーン投写式汎用筐体(試作品)。

PlayStation2のころには、ストリーミング、PCMを使いこなすことによって、今までにないリアリティのある音作りをもっと追求できるなというところで、いったんMIDIを手放してみたりもしましたね。

MIDIはインタラクティブなコントロールをすることで便利になるのですけれども、それをドライバに組み込むとなると、実は手がかかる規格でもあるので、MIDI対応から離れて、PCMのいろんな制御だけで表現できるものをいろいろ作っていこうと試行錯誤していました。

黒畑:それまでは「楽器を作る」的なイメージだったのが、そこから変わってきたということですね。

中西:曲はPCMできれいなループも取れて、しかもそれをマルチストリーミングできるというのがPlayStation2の時代により実用的になってきたので、BGMを鳴らしつつ、効果音も同時にストリーミングを使いました。『エースコンバット04 シャッタードスカイ』では無線通信の音声をマルチストリーミングかつシーケンス接続再生ができたので、いろんなパーツ音声を組み合わせつつ味方の無線のバリエーション再生を実現できました。このころは大容量PCM音源データの活用が進んだ時代でしたね。ここから共通のシステムを作るということがはじまったわけです。

NUSoundという名前が先ほど出てきましたが、これが作られた理由は、PlayStation2だけではなく、ニンテンドーゲームキューブ、Xboxと家庭用ゲーム機が増えていくなかでマルチプラットフォーム向けにタイトルを制作することになったからですね。

ライブラリを共通化することで、苦労するのは最初のひとりだけで済むようにと(笑)。実際は数人関わることになるわけですけれども、それぞれのプロジェクトごとに必要以上の負担がないことが実現していったのです。

黒畑:当時私は使う側で、NUSound1を採用したタイトルで一番最初に発売された『ミスタードリラー ドリルランド』(2002年12月20日)に関わっていました。『R:RACING EVOLUTION』(2003年11月27日)も同時期にNUSound1を使って開発されていて、発売が後ろにずれていって結局『ミスタードリラー ドリルランド』が先にリリースされたという感じだったと記憶しています。

中西:『ソウルキャリバーII』も3プラットフォーム対応で同時リリースされたので、このあたりのタイトルがNUSound1の初期の採用タイトルかな。ほかには、PlayStation2だけですが『ゆめりあ』(2003年4月24日)にも使われていました。2002~2003年ごろです。

<大久保さんの解説>

ここで言うMIDIというのは、PlayStationやPlayStation2になってもいったんMIDIデータを作ってから、ゲーム機の中の楽器、PCMで作成されたサンプリング音源をシーケンスするためにMIDIシーケンスファイルを読み込ませてゲーム機の中の音源を鳴らすということをやっていました。

そこから楽器を入れてシーケンサーを使って鳴らすという考え方をやめて、BGMはCDやDVDからストリーミング(随時読み出し)で鳴らして、音声や効果音は全部メモリに入れた波形かストリーミングで鳴らしましょう、というのが新しい考え方になったということです。

中西:PlayStationのころは曲はストリーミングだからよかったのですが、PCMに使えるメモリ領域は少なかったので、効果音はMIDI的な鳴らし方も必要でした。

PlayStation2になってから、メモリ領域がけっこう使えるようになったので、効果音についても潤沢にPCMを使えるようになってきたんですね。効果音の制御の仕方も重要な課題だったので、それを共通の仕組みで使えるようにするという考えがNUSoundの起点だったと思います。

ただ、この時期にMIDIを捨てたことで効率は上がったのですが、BGMに関してはインタラクティブ性を犠牲にした部分もあって。

黒畑:BGMのほうはストリーミングでせいぜいループができる、というぐらい。

中西:当時は音楽をマルチストリーミングで切れ目なくつなげるといったことはなかなか難しい時代でした。

大久保:BGMもインタラクティブにやろうとがんばっていたのはPlayStation時代でしたね。

中西:PlayStationではがんばって作っていましたね。けっこうインタラクティブな演出をやっていました。

大久保:CD-DAをただ鳴らすだけではなくて、ちょっと圧縮したデータを8トラックぐらいまでマルチストリーミングできるような仕組みを作って、8chあるデータのどれを鳴らすか、ということは選べるようになったから、例えば洞窟の中に入ったら、それまでに流していたトラックから洞窟に入った時のBGMのトラックに切り替えるという形でやっていましたね。

中西:インタラクティブな変化を出していましたね。『風のクロノア』(1997年12月11日)とか。PlayStation2のころまでそんな形でたくさんのタイトルをやっていましたが、BGMに関してのインタラクティブな演出というのは積極的に使えていなかった時代ですね。

大久保:でも僕らは忘れられない過去の音楽のインタラクティブ性があって、それをなんとか再現したいって気にしていて。『R:RACING EVOLUTION』の時に、車の速度が上がったら曲も早くなるという仕組みを誰かが作っていたよね(笑)。

中西:BGMの再生スピード変更ですね。インタラクティブ性に関してずっと大久保さんは気にされていましたよね。

大久保:それで音楽のスピードを変えるというチャレンジをしてみたのですが、聞いてみると気持ちが悪くてやってられなかった。

中西:スピードを変えると音程も変わってしまうので(笑)。

大久保:試行錯誤というか、いろいろ考えていた時期がありました。

中西:映像も進化していって、シンセサイザー+シーケンスで音を作るのはUI(ユーザーインターフェース)ぐらいになってしまって、それ以外はサンプリング(録った音を再生する)表現になりました。「まあ、サンプリングしてしまえばいいや」という利便性は大きかったです。僕たちはそこでMIDIシーケンス表現をいったん置いていくことにしました。会社によってはインタラクティブ的なものにこだわりをもって続けてこられたところもあると思うのですが、ある意味いったん考えを切り替えて置いてみたという感じですね。

ストリーミングで流れているBGMと同等の音をMIDIシーケンス+サンプラーで作りこもうと思うと相当なコストがかかってしまうので、そこまで凝ってやることはあまりなかったかなと。(絵柄が)デフォルメされたゲームならMIDIシーケンス的な表現の音でもけっこう世界観に合うからいいかなと思っていたんですけど、PlayStation2ぐらいから映像表現がリアル寄りになってきたので、このような選択がされていましたね。ここまでがPlayStation2時代です。PlayStation3の時代から、私と黒畑、大久保さんが一緒に絡んでくるタイミングが来ます。

――PlayStation2世代までサウンド周りに関しては、いろんな試行錯誤が続いたのですね。ありがとうございます。

「Bandai Namco Game Music」についてはこちら

バンダイナムコ知新「第8回 第2章ナムコサウンドの発展の足跡を追う【前編】」小川徹氏、細江慎治氏、川田宏行氏、中西哲一氏、黒畑喜弘氏、大久保博氏インタビュー

バンダイナムコ知新「第8回 第2章ナムコサウンドの発展の足跡を追う【中編】」

※バンダイナムコ知新では、当時の資料や関係者への取材をはじめ、皆さまの知見もお借りし、できる限り正確な記事を目指しております。一部事実と異なる場合がございましたら、後日訂正をさせていただきますので、予めご了承いただけますと幸いです。

【※本記事に引用している参考資料につきまして】

・本文中のBGMや効果音などの音源へのリンクは、お客さまのご利用環境によってアクセスできない場合があります。

・動画は、移植版タイトルのものを引用しています。

【補足】タイトル後の年号はアーケード版は稼働開始年、家庭用版は発売日を表記しております。

【編集後記】

アーケードゲームがビデオゲームの技術の最先端の世界をまい進し続けた結果、ナムコ音源もPCMを主流とした流れ――「録ったものを流す」世代に到達します。一方、ソフト交換式の家庭用ゲーム機もコストの制約のなか、当時としては安価で製造できる大容量のCD-ROMの採用へと舵を切っていきます。アーケードとは同じようで少し違うCD(メディアストリーム)の活用時代の到来です。その過程でサウンドスタッフもチームが分かれるなどし、独自の制作環境に対応していく動きが出てきたのが本稿の時代といえるでしょう。第2章のラストとなる次回は、ソフトウェアによる音源の制御について引き続きお話を伺っていきます。第8回第2章も第1章に引き続き、大久保さんにアドバイザー兼インタビュアーとしてご協力いただきました。また、インタビュイーの皆さまにも内容をご確認いただき、当時の貴重な情報を追加していただきました。この場をお借りして御礼を申し上げます。

取材・文/佐伯 憲司

ライター/編集者。ゲーム関連本、ニュースサイト、攻略映像などに関わったのち、現在フリー。ナムコのゲームとの出会いは、薄暗い中で極彩色の色とド派手なステージスタート音に思わず2度見した『ギャラクシアン』。当時は「ゲームセンター」だけではなく喫茶店や個人商店のはなれなどでもゲーム機と出会うことができました。

1979年、ナムコ(当時)に入社、半年の営業研修後、ビデオゲーム開発部署に配属(当時『パックマン』を試作中)。『ギャラガ』プログラマーを担当後、ハードウエア開発、3Dハード前までの各種ハード、システム基板、カスタムICなどの設計を担当。JAMMA VIDEO規格専門小委員会に参加(副委員長)、通信プロトコル草案の策定にも携わる。PlayStation®︎互換アーケード基板「SYSTEM11」をSCE(ソニー・コンピュータエンタテインメント:当時)と共同開発。量産治具「フラッシュライタ」を製作。その後、役職定年で希望してAMサービス部に転籍。アーケードハードの修理を現在行っている。